近期,計(jì)算機(jī)視覺領(lǐng)域最具權(quán)威性的國際頂級學(xué)術(shù)會議之一ICCV2025正式放榜,如視首席科學(xué)家潘慈輝及其團(tuán)隊(duì)科研成果《EDM: Efficient Deep Feature Matching》被接收并入選為Highlight論文。該論文聚焦高效的半稠密圖像特征匹配方向,提出突破性解決方案。

ICCV(國際計(jì)算機(jī)視覺大會)與CVPR(計(jì)算機(jī)視覺與模式識別會議)、ECCV(歐洲計(jì)算機(jī)視覺會議)一同被視為計(jì)算機(jī)視覺領(lǐng)域的三大頂會,在全球范圍內(nèi)有著極高的學(xué)術(shù)地位和行業(yè)影響力。數(shù)據(jù)顯示,今年ICCV共收到11239份有效投稿,最終接受2698篇論文,錄用率僅為24%。

本次入選ICCV 2025,是如視的科研成果繼CVPR 2023、CVPR 2022后又一次入選國際頂會,代表著如視在視覺匹配這一重要的圖像處理研究內(nèi)容上達(dá)到了國際前沿水平,也彰顯了如視將技術(shù)創(chuàng)新和產(chǎn)業(yè)應(yīng)用相結(jié)合的硬實(shí)力。

ICCV2025

打破技術(shù)瓶頸,填補(bǔ)學(xué)術(shù)空白

盡管基于深度學(xué)習(xí)的特征匹配方法近年取得顯著精度提升,但主流研究長期受限于將匹配視為底層任務(wù)的傳統(tǒng)認(rèn)知,手工設(shè)計(jì)的特征描述以及當(dāng)前主流的神經(jīng)網(wǎng)絡(luò)的架構(gòu)設(shè)計(jì)局限在淺且寬的范式,導(dǎo)致深層語義信息捕獲不足且計(jì)算效率低下。

針對現(xiàn)有瓶頸,如視做出以下的研究突破:

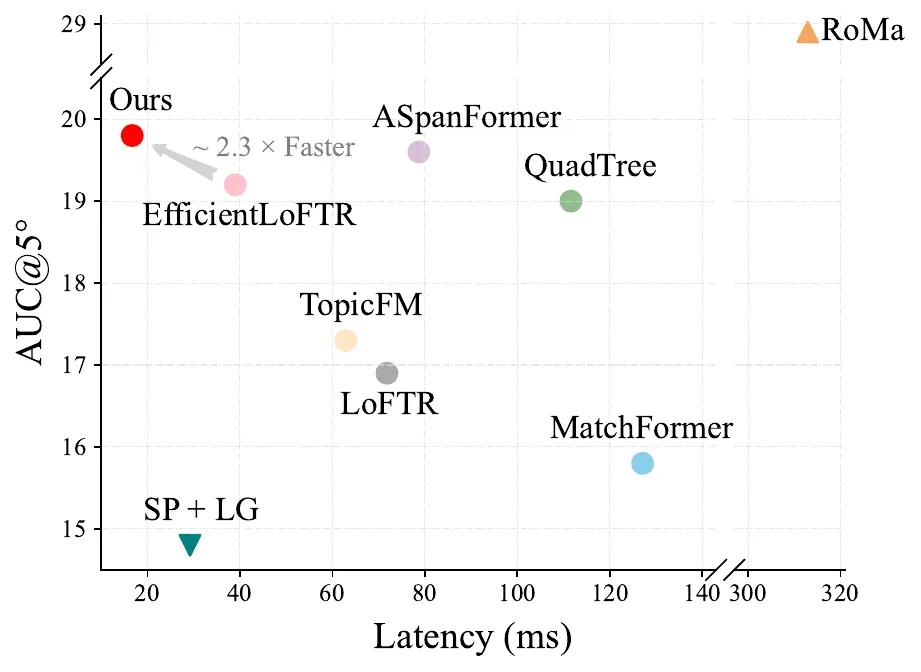

更深更強(qiáng)的特征提取

突破傳統(tǒng)認(rèn)知,采用深層網(wǎng)絡(luò)捕捉高級語義信息,通過創(chuàng)新的 “相關(guān)性注入模塊”,將深層特征的全局關(guān)聯(lián)高效融入局部特征,兼顧精度與效率。

亞像素定位新范式

用輕量的、基于軸的雙向回歸頭來估計(jì)亞像素級的細(xì)粒度匹配,避免了過往計(jì)算繁重的特征上采樣和熱力圖定位特征點(diǎn)的問題。

匹配選擇策略創(chuàng)新

為粗匹配和細(xì)匹配階段都設(shè)計(jì)了新的匹配選擇策略,在提升匹配精度的同時(shí)大幅優(yōu)化計(jì)算效率。

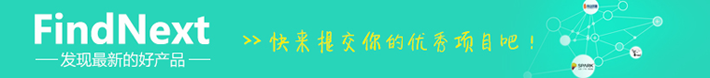

和當(dāng)前主流方法的精度和效率對比圖

如視團(tuán)隊(duì)的研究成果,填補(bǔ)了真正高效的半稠密匹配器缺失這一學(xué)術(shù)空白,自研了目前最高效且性能非常有競爭力的半稠密匹配器,擁有廣泛的應(yīng)用前景。

流程圖

如視產(chǎn)品的技術(shù)落地

作為基礎(chǔ)視覺工具,這項(xiàng)特征匹配技術(shù)已在如視產(chǎn)品中得到應(yīng)用,大幅提升了圖像拼接的精度和效率。

例如,在多點(diǎn)位采集時(shí),伽羅華可以憑借精準(zhǔn)的特征匹配能力,確保空間關(guān)鍵點(diǎn)位的記錄更精準(zhǔn),減少數(shù)據(jù)偏差;針對搭載多鏡頭的龐加萊通過校準(zhǔn)不同鏡頭拍攝圖像的特征關(guān)聯(lián),保障了多鏡頭畫面在色彩、視角和空間坐標(biāo)上的一致性,從源頭避免因圖像不一致導(dǎo)致的誤差;同時(shí),輕量版本的EDM技術(shù)支持端側(cè)實(shí)現(xiàn)高效的位姿拼接,讓設(shè)備在采集過程中能實(shí)時(shí)、流暢地完成空間數(shù)據(jù)的整合。在使用云臺采集、手機(jī)拍全景圖拼接時(shí),系統(tǒng)的魯棒性更佳,即使在復(fù)雜環(huán)境下也能實(shí)現(xiàn)流暢拼接。

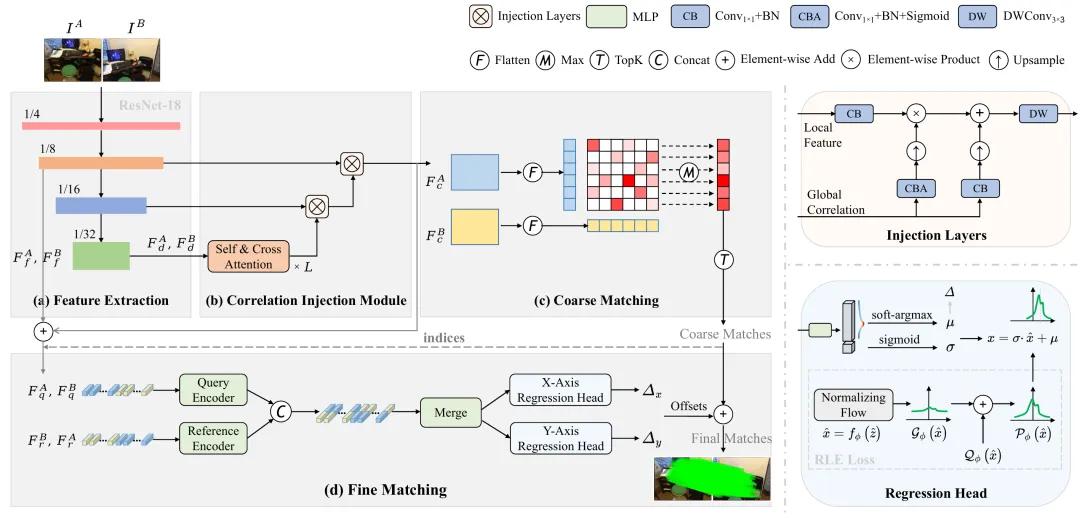

與 LoFTR 和 EfficientLoFTR 相比,如視的方法在存在大視角變化和重復(fù)語義的場景中表現(xiàn)出更強(qiáng)的魯棒性

再比如在博物館的場景中,EDM通過精準(zhǔn)的視覺變換算法實(shí)現(xiàn)自然的素材對齊,讓高清細(xì)節(jié)照片與整體空間環(huán)境完美融合,仿佛原生生長在場景中,既保留細(xì)節(jié)清晰度,又不破壞空間的整體透視邏輯,使得用戶在線觀展體驗(yàn)更加自然。

更廣闊的產(chǎn)業(yè)應(yīng)用

從更廣泛的產(chǎn)業(yè)實(shí)際應(yīng)用出發(fā),如視的這項(xiàng)成果可以通用于任何涉及到圖像匹配的視覺任務(wù)。

在AR導(dǎo)航、自動駕駛、機(jī)器人視覺導(dǎo)航等空間智能領(lǐng)域,這項(xiàng)技術(shù)的價(jià)值也同樣顯著:通過實(shí)時(shí)匹配環(huán)境特征與預(yù)設(shè)數(shù)據(jù),讓 AR 虛擬信息精準(zhǔn)疊加在真實(shí)場景上;輔助自動駕駛車輛迅速感知路況位置;讓機(jī)器人能夠在復(fù)雜環(huán)境中精確規(guī)劃路徑.....從底層提升各類空間交互任務(wù)的精度與可靠性。

技術(shù)的進(jìn)步永不止步,榮登學(xué)界頂會是如視在此方向上長期積累的結(jié)果。如視將在空間數(shù)智化領(lǐng)域不斷拓界,持續(xù)深耕技術(shù)研究與產(chǎn)業(yè)落地的閉環(huán),為行業(yè)貢獻(xiàn)更多前沿創(chuàng)新成果。